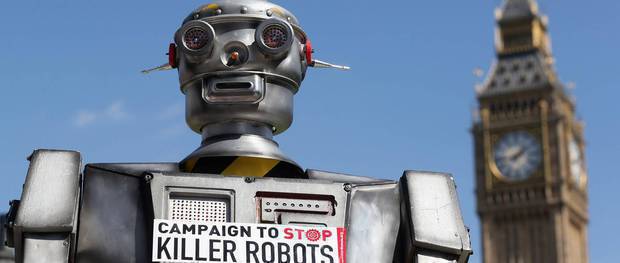

В середине этого месяца в Женеве правительства встретились для того, чтобы обсудить, что же делать с «роботами-убийцами». Amnesty International призывает к организации официального переговорного процесса с целью объявления нового всемирного запрета на применение «роботов-убийц» летального и нелетального действия, как в районах боевых действий, так и в рамках полицейских операций. Сегодня мы решили перечислить 10 причин, почему такой запрет необходим.

Роботы-убийцы - это системы вооружений, которые после активации могут выбирать, атаковать, убивать и ранить живые цели без контроля со стороны человека. Когда-то они были просто атрибутом фантастических антиутопий, но скоро это оружие, которое ещё называют «полностью автоматическими оружейными системами», станет реальностью. У этой технологии уже существует множество прототипов . Например, дрон ShadowHawk, созданный Vanguard Defense Industries, может быть оснащён гранатомётом, дробовиком с лазерным целеуказателем или оружием нелетального действия, тазером или другим травматическим оружием. В 2011 департамент шерифа в округе Монтгомери, штат Техас, на грант, полученный от Министерства внутренней безопасности, приобрёл дрон ShadowHawk без вооружений. В августе этого года Северная Дакота стала первым штатом в США, где был узаконено дистанционное применение дронов, которые могут обезвреживать людей с помощью электрошокера высокого напряжения.

Некоторые правительства доказывают, что «роботы-убийцы» могут уменьшить риски, связанные с дислоцированием солдат в зоне боевых действий или полицейских во время опасных правоохранительных операций. Таким образом их применение облегчит правительствам вступление в новые вооружённые конфликты и использование силы при поддержании порядка, например, во время протестов. Несмотря на то, что солдаты и полицейские может быть и будут в большей безопасности, но подобное снижение порога опасности может привести к большему количеству конфликтов и случаев применения силы и, следовательно, к большей опасности для гражданских лиц.

Сторонники «роботов убийц» также заявляют, что отсутствие у них эмоций устранит такие свойственные человеку негативные проявления, как страх, месть, ярость и человеческая ошибка. Однако, человеческие эмоции иногда могут служить основным препятствием для убийства или нанесения вреда гражданским лицам, а роботы могут быть легко запрограммированы на проведение неизбирательных или произвольных атак на людей, даже в массовом порядке. «Роботы-убийцы» неспособны отказаться выполнять приказы, что порой может спасти человечесие жизни. Например, во время массовых протестов в Египте в январе 2011, армия отказалась стрелять по протестующим, действие для которого требуется врождённое человеческое сострадание и уважение верховенства закона.

Международные стандарты в области охраны правопорядка запрещают использование огнестрельного оружия, за исключением случаев защиты от неминуемой угрозы смерти или серьёзного увечья, а сила может применяться только в минимально необходимом объёме. Очень трудно представить машину, использующую человеческую оценку ситуации, когда существует непосредственная и прямая опасность того, что один человек собирается убить другого человека, и применяет минимально необходимую силу для того, чтобы остановить нападение. Между тем такая оценка ситуации крайне важна, когда сотрудник полиции принимает решение о применении оружия. В большинстве ситуаций стандарты ООН требуют от полиции в первую очередь использовать ненасильственные методы, такие как убеждение, переговоры и снижение напряжённости, прежде чем переходить к применению силы в любой форме.

Эффективная работа полиции - это нечто большее, чем просто применение силы. Эта работа требует исключительно человеческих способностей к сопереживанию и отрицанию, а также умения оценивать и реагировать на часто стремительно изменяющиеся и непредсказуемые обстоятельства. Эти способности нельзя свести к простым алгоритмам. Они требуют анализа постоянно изменяющихся ситуаций и принятия решений о том, как наилучшим образом и на законных основаниях защитить право на жизнь и физическую неприкосновенность, на что машины попросту неспособны.

При решении сотрудников правоохранительных органов о применении минимальной силу в конкретных ситуациях требуется прямая человеческая оценка характера угрозы и реального контроля над любым оружием. Проще говоря, решения, от которых зависит жизнь человека, нельзя поручить выносить машинам.

Избирательность, пропорциональность и проявление предосторожности - вот три главных принципа международного гуманитарного права, законов и обычаев войны. Вооружённые силы должны проводить различия между комбатантами и некомбатантами. Жертвы среди мирного населения и ущерб гражданским объектам не должен быть чрезмерным по отношению к ожидаемым военным успехам. И все стороны должны принимать все разумные меры предосторожности для защиты мирного населения.

Всё это, очевидно, требует человеческой оценки. Роботы неспособны анализировать намерения, лежащие в основе действий людей, или принимать сложные решения о пропорциональности или необходимости атаки. Не говоря уж о необходимости проявлять сочувствие и сострадание к гражданским лицам в условиях войны.

Если действия робота будут незаконными, то как привлечь его к ответственности? Тех, кто занимается его программированием, производством и боевым применением, как и вышестоящих должностных лиц и политических лидеров можно привлечь к ответственности. Однако все эти лица не могут предусмотреть как «робот-убийца» будет реагировать на те или иные конкретные обстоятельства, что потенциально приводит к ситуации, когда привлекать к ответственности будет некого.

Даже сейчас расследования по поводу незаконных убийств с помощью ударов с беспилотников проводятся крайне редко, а виновные привлекаются к ответственности ещё реже. В своём докладе об ударах беспилотников США в Пакистане Amnesty International рассказывает о секретности, окружающей применение администрацией СШA беспилотников для убийства людей и её отказ разъяснить международно-правовую основу индивидуальных атак, вызывает обеспокоенность по поводу того, что удары по пакистанской Территории племён также могли нарушать права человека.

Привлечение к ответственности виновных за удары с беспилотников и так оказалось достаточно трудной задачей, а если учесть, насколько увеличится сложность механизма принятия решений при выборе цели и убийстве, в которых будут участвовать «роботы-убийцы», мы скорее всего увидим только увеличение количества незаконных убийств и травм, как во время вооружённых конфликтов, так и во время полицейских операций.

В Китае, Израиле, России, Южной Корее, Великобритании, США и другие государства сейчас разрабатывают системы, которые позволят машинам быть более автономными в бою. Компании в ряде стран уже разработали полуавтоматическое роботизированное оружие, которое может стрелять слезоточивым газом, резиновыми пулями и дротиками электрошокеров во время операций по поддержанию правопорядка.

История развития вооружений даёт все основания предполагать, что это лишь вопрос времени, когда начнётся очередная гонка высокотехнологичных вооружений, во время которой государства будут стремиться разработать и купить такие системы, что приведёт к их широкому распространению. Эти системы окажутся в арсеналах беспринципных правительств и, в конце концов, в руках негосударственных субъектов, в том числе групп вооружённой оппозиции и преступных группировок.

Дать роботам право принимать решения жить людям или умирать противоречит фундаментальной морали. У них нет эмоций, сострадания и сопереживания, а их применение нарушило бы право человека на жизнь и человеческое достоинство. Использовать машины для убийства людей - это полное пренебрежение человеческим достоинством.

Как мы видим на примере возрастающего и бесконтрольного применения беспилотников, как только система вооружений начинает использоваться, то уже становится невероятно трудно или почти невозможно регулировать или даже ограничить её применение.

Если информация из «Материалов по беспилотникам», опубликованных недавно The Intercept, подтвердится, то перед нами возникнет крайне тревожная картина программы США по убийствам с беспилотников. В этих документах говорится, что 90% людей, убитых за пять месяцев атак с беспилотников США, были непреднамеренными целями, что подчёркивает многолетний отказ администрации США обеспечить прозрачность программе использования беспилотников.

По-видимому уже слишком поздно запрещать применение вооружённых беспилотников, тем не менее их применение должно быть радикально ограниченно ради спасения жизней мирных жителей. «Роботы-убийцы» значительно увеличат риск незаконных убийств. И именно поэтому такие роботы должны быть запрещены превентивно. Подход «поживём - увидим» может повлечь за собой только дальнейшие инвестиции в разработку и стремительное распространение таких систем.

В июле 2015 года некоторые из ведущих мировых разработчиков искусственного интеллекта, учёных и специалистов из смежных областей подписали открытое письмо с призывом к полному запрету «роботов убийц».

На данный момент письмо подписали 2 587 человек, в том числе более 14 действующих и бывших президентов организаций и профессиональных объединений, занимающихся разработками искусственного интеллекта и роботов. Сред них и Демис Хассабис, управляющий проектом DeepMind в Google, Илон Маск, президент компании Tesla, Стив Возняк, один из основателей Apple, один из создателей Skype Яаан Таллин и учёный Стивен Хокинг.

Если тысячи научных экспертов и юристов настолько обеспокоены разработкой и потенциальным применением «роботов убийц» и согласны с кампанией «Остановим роботов убийц», в том, что их необходимо запретить, то чего же ждут правительства?

С тех пор, как проблемы, возникающие в связи с «роботами убийцами», были впервые озвучены в апреле 2013 года, единственным содержательным обсуждением этой проблемы были две недельные неформальные встречи экспертов в Женеве на конференции по Конвенции ООН о конкретных видах обычного оружия. Трудно поверить, что настолько серьёзной угрозе было уделено так мало времени и до сих пор почти ничего не сделано.

Для Amnesty International и её партнёров по кампании «Остановим роботов убийц» единственным настоящим решением этой проблемы является полный запрет на разработку, развёртывание и применение летальных автоматизированных систем оружия.

Мир не может больше ждать, когда будут приняты меры против настолько серьёзной и глобальной угрозу. Пора запретить роботов убийц, раз и навсегда.

Автор: Раша Абдул Рахим, эксперт по вопросам контроля за распространением вооружений, торговли средствами безопасности и правам человека в Amnesty International